近期,華為AI算法團隊表示在人工智能領域取得顯著突破,研究併發表一種創新的大模型 KV Cache 壓縮算法,稱為「RazorAttention」。

3 h/ l, v8 Y! J/ @4 w# H% s 公仔箱論壇2 d: U' a% M; J+ i. R- G4 h0 [

5 h2 I3 @! d. w5 p4 |* W公仔箱論壇: @; Y2 L) J+ U, K& b7 C

新算法具有卓越的性能表現,可以有效節省高達 70%的大模型推理 RAM 佔用,AI 大模型提供更多的空間,提供強有力的支援。 新算法具有卓越的性能表現,可以有效節省高達 70%的大模型推理 RAM 佔用,AI 大模型提供更多的空間,提供強有力的支援。

7 A7 d. v" m: c2 ~% A( l" n' ctvb now,tvbnow,bttvb 目前相關論文《RazorAttention: Efficient KV Cache Compression Through Retrieval Heads》已被深度學習領域國際頂級會議 ICLR 2025 收錄,可見其重要性。6 H: D1 N b+ I$ x, l 目前相關論文《RazorAttention: Efficient KV Cache Compression Through Retrieval Heads》已被深度學習領域國際頂級會議 ICLR 2025 收錄,可見其重要性。6 H: D1 N b+ I$ x, l

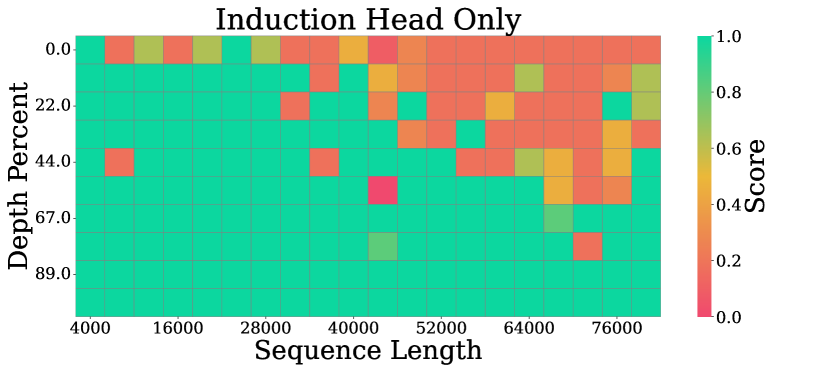

華為表示,RazorAttention 是業界首個基於 Attention 可解釋性的離線靜態 KV Cache 壓縮算法,打破一直以來 AI 大模型長序列 KV Cache 壓縮不理想的硬傷,減少設備負擔,提高計算速度。tvb now,tvbnow,bttvb3 w# T( [1 [0 a5 I4 z5 |+ Z3 L8 a. |

RazorAttention 是通過檢索頭的設定,保證上下文中重要且主要的信息保留,且在保持高精度(誤差小於1%)的前提下,實現靜態有效壓縮最大70% 的 KV Cache RAM 佔用,大大減少 AI 大模型推理的成本。- _" B9 J! B1 @

值得一提的是,目前 RazorAttention 算法已實現產品化,並集成在昇騰 MindIE/MindStudio,支援主流 8K~1M 長序列 KV Cache 壓縮,在 32K 以上場景增量吞吐提升20%+。 |